Manipulierte News-Feeds bei Facebook – Wahrheit oder Fake?!

Ein Moment Ihrer Zeit für die Wahrheit.

In einer Welt voller Fehlinformationen und Fake News ist es unser Auftrag bei Mimikama.org, Ihnen zuverlässige und geprüfte Informationen zu liefern. Tag für Tag arbeiten wir daran, die Flut an Desinformation einzudämmen und Aufklärung zu betreiben. Doch dieser Einsatz für die Wahrheit benötigt nicht nur Hingabe, sondern auch Ressourcen. Heute wenden wir uns an Sie: Wenn Sie die Arbeit schätzen, die wir leisten, und glauben, dass eine gut informierte Gesellschaft für die Demokratie essentiell ist, bitten wir Sie, über eine kleine Unterstützung nachzudenken. Schon mit wenigen Euro können Sie einen Unterschied machen.

Stellen Sie sich vor, jeder, der diese Zeilen liest, würde sich mit einem kleinen Beitrag beteiligen – gemeinsam könnten wir unsere Unabhängigkeit sichern und weiterhin gegen Fehlinformationen ankämpfen.

So kannst Du unterstützen:

PayPal: Für schnelle und einfache Online-Zahlungen.

Steady oder Patreon: für regelmäßige Unterstützung.

Autor: Tom Wannenmacher

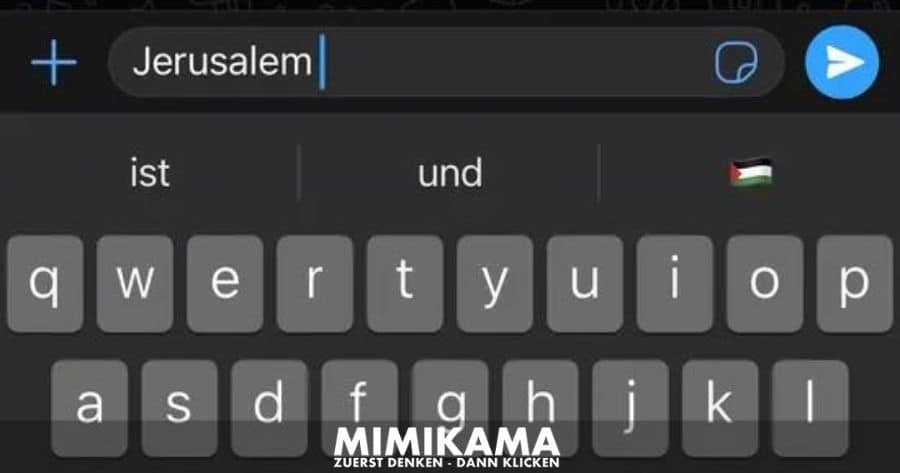

Die Startseite bei Facebook wurde für eine Studie einigen Hunderttausenden Nutzern manipuliert: Sie bekamen ein verändertes Bild von der Stimmung ihrer Freunde gezeigt.

Der Newsfeed bei Facebook (die Startseite, die sich Neuigkeiten nennt), ist für viele Hundert Millionen Nutzer eine wichtige Einrichtung, die viel von seinen Freunden und Kollegen zeigen kann. Hier sieht man, was Bekannte tun, was Kollegen für mitteilenswert halten, wie es den Freunden gerade geht.

Oder doch nicht?

Ungefähr 310.000 Nutzer sahen im Rahmen eines Psychologie-Experiments einen manipulierten Newsfeed, ohne ihr Wissen.

Eine Gruppe sah vor allem positive Einträge ihrer Freunde, eine andere fast nur Negative.

Das Experiment fand schon im Januar 2012 statt und betraf insgesamt 689.003 englischsprachige Nutzer. Das Experiment lief etwa eine Woche lang.

Anfang Juni wurde die Studie nun veröffentlicht. Doch erst jetzt, mit vier Wochen Verspätung rollt eine Empörungswelle an.

Viele Nutzer sind entsetzt darüber, dass sie ohne Zustimmung als Versuchskaninchen eingesetzt wurden und ihnen ein verfälschtes Bild von ihrem Freundeskreis gezeigt wurde.

Das Pikante: Zwar haben Wissenschaftler immer wieder auf Daten von Facebook zurückgegriffen, doch dieses Experiment ist wohl das Erste, dass die Informationen im Netzwerk verfälscht – unter Mitarbeit von Facebook-Angestellten! Hierzu wurde der Algorithmus verändert.

Eine Forscherin, die die Veröffentlichung der Studie für das Fachblatt „Proceedings of the National Academy of Sciences“ betreute, sagte, sie sei zunächst besorgt gewesen. Forscher und Facebook hätten aber versichert, dass alles rechtens sei.

Facebook-Mitarbeiter manipulierten doch ohnehin die Newsfeeds der Nutzer, sei eines der Argumente gewesen, sagte die Forscherin dem Magazin „The Atlantic“.

„Emotionale Ansteckung“ funktioniert ohne direkten Kontakt

Wenn Experimente dieser Art an bspw. Universitäten durchgeführt werden, muss eine Ethik-Kommission zustimmen. Für Privatfirmen, wie Facebook gilt dies nicht. Die Studie ist allerdings von den Nutzungsbestimmungen des Netzwerks, dass alle Nutzer unterschrieben haben, gedeckt.

Wegen der Empörung der Nutzer betonte man, dass die Beiträge selbst ja gar nicht entfernt wurden. Ging man auf die Profilseiten der Freunde, seien die zuvor nicht angezeigten Nachrichten (im Newsfeed) sichtbar gewesen.

Das Ergebnis klingt erst einmal wenig überraschend!

Wer mehr positive Nachrichten in seinem Newsfeed las, postete auch selbst eher Positives. Bei der negativen Gruppe war es ähnlich, nur wer Negatives las, postete auch selbst eher Negatives. Bei der negativen Gruppe gab es diesen Zusammenhang ebenfalls.

Verweise:

Even the Editor of Facebook’s Mood Study Thought It Was Creepy

Manipulierte Newsfeeds: Facebook-Nutzer empört über Psycho-Experiment

Psychospielchen: Facebook manipuliert heimlich 700.000 Newsfeeds

Facebook manipulierte für Studie Nachrichtenstrom

Autor: Johannes Lemmer, mimikama.org und Richtsberg Journal

FAKE NEWS BEKÄMPFEN

Unterstützen Sie Mimikama, um gemeinsam gegen Fake News vorzugehen und die Demokratie zu stärken. Helfen Sie mit, Fake News zu stoppen!

Mit Deiner Unterstützung via PayPal, Banküberweisung, Steady oder Patreon ermöglichst Du es uns, Falschmeldungen zu entlarven und klare Fakten zu präsentieren. Jeder Beitrag, groß oder klein, macht einen Unterschied. Vielen Dank für Deine Hilfe! ❤️

Mimikama-Webshop

Unser Ziel bei Mimikama ist einfach: Wir kämpfen mit Humor und Scharfsinn gegen Desinformation und Verschwörungstheorien.

Hinweise: 1) Dieser Inhalt gibt den Stand der Dinge wieder, der zum Zeitpunkt der Veröffentlichung aktuell

war. Die Wiedergabe einzelner Bilder, Screenshots, Einbettungen oder Videosequenzen dient zur

Auseinandersetzung der Sache mit dem Thema.

2) Einzelne Beiträge (keine Faktenchecks) entstanden durch den Einsatz von maschineller Hilfe und

wurde vor der Publikation gewissenhaft von der Mimikama-Redaktion kontrolliert. (Begründung)

Mit deiner Hilfe unterstützt du eine der wichtigsten unabhängigen Informationsquellen zum Thema Fake News und Verbraucherschutz im deutschsprachigen Raum

INSERT_STEADY_CHECKOUT_HERE

Kämpfe mit uns für ein echtes, faktenbasiertes Internet! Besorgt über Falschmeldungen? Unterstütze Mimikama und hilf uns, Qualität und Vertrauen im digitalen Raum zu fördern. Dein Beitrag, egal in welcher Höhe, hilft uns, weiterhin für eine wahrheitsgetreue Online-Welt zu arbeiten. Unterstütze jetzt und mach einen echten Unterschied! Werde auch Du ein jetzt ein Botschafter von Mimikama

Mehr von Mimikama

Mimikama Workshops & Vorträge: Stark gegen Fake News!

Mit unseren Workshops erleben Sie ein Feuerwerk an Impulsen mit echtem Mehrwert in Medienkompetenz, lernen Fake News und deren Manipulation zu erkennen, schützen sich vor Falschmeldungen und deren Auswirkungen und fördern dabei einen informierten, kritischen und transparenten Umgang mit Informationen.