Hinter den Kulissen von Facebook – Was geschieht, wenn man etwas meldet?

Autor: Andre Wolf

Wir brauchen deine Hilfe – Unterstütze uns!

In einer Welt, die zunehmend von Fehlinformationen und Fake News überflutet wird, setzen wir bei Mimikama uns jeden Tag dafür ein, dir verlässliche und geprüfte Informationen zu bieten. Unser Engagement im Kampf gegen Desinformation bedeutet, dass wir ständig aufklären und informieren müssen, was natürlich auch Kosten verursacht.

Deine Unterstützung ist jetzt wichtiger denn je.

Wenn du den Wert unserer Arbeit erkennst und die Bedeutung einer gut informierten Gesellschaft für die Demokratie schätzt, bitten wir dich, über eine finanzielle Unterstützung nachzudenken.

Schon kleine Beiträge können einen großen Unterschied machen und helfen uns, unsere Unabhängigkeit zu bewahren und unsere Mission fortzusetzen.

So kannst du helfen!

PayPal: Für schnelle und einfache Online-Zahlungen.

Steady: für regelmäßige Unterstützung.

„Wir haben die von dir wegen Hassbotschaften oder -symbolen gemeldete Seite geprüft und festgestellt, dass sie nicht gegen unsere Gemeinschaftsstandards verstößt“. Solche und ähnliche Antworten bekommen User häufig von Facebook, nachdem sie eine Seite gemeldet haben. Unverständnis ist häufig die Folge, es wird über die „Bots“ geschimpft, welche wohl bestimmen, was gegen die Standards verstößt und was nicht.

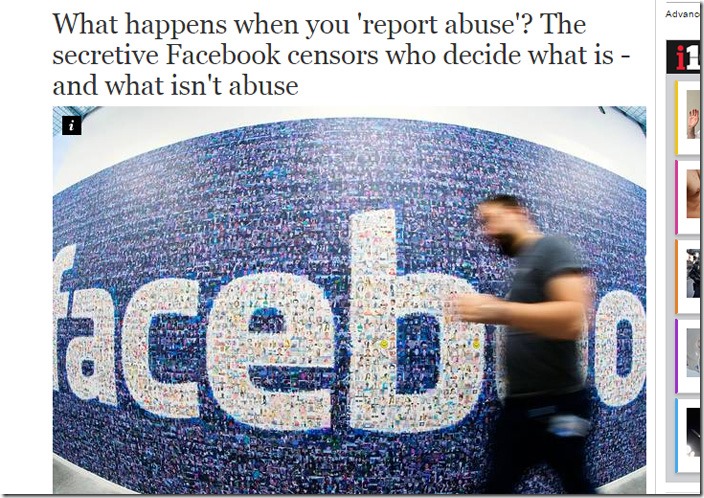

Chris Green, ein Reporter des UK-Magazins „The Independent“ durfte nun als Erster einen Blick in die europäische Facebook-Zentrale in Dublin werfen, um dem sogenannten „Community Operations Team“ über die Schulter zu schauen.

(Screenshot: The Independent)

Außerhalb Kaliforniens, dem Hauptsitz von Facebook, ist Dublin der wichtigste Standort. Hier werden nicht nur Meldungen aus Europa, sondern auch aus dem mittleren Osten, Afrika und einem Großteil Lateinamerikas koordiniert und den einzelnen Abteilungen zugewiesen. Sonia Flynn, die Geschäftsführerin von Facebook Irland, erzählt, dass, während der Großteil der Meldungen eher harmloser Natur ist, so gibt es doch auch jene Fälle, in denen schnell und mit entschlossen gehandelt werden muss.

Um auch sämtliche Sprachen abzudecken, gibt es alleine in Dublin Mitarbeiter aus 44 Nationen, welche nicht nur die Sprache flüssig beherrschen, sondern sich auch mit der jeweiligen Landeskultur auskennen müssen. Darauf legt Facebook sehr viel wert, so Sonia Flynn.

Ciara Lyden, ihres Zeichens Managerin für Inhaltsbestimmungen auf Facebook, räumt mit einem Mythos auf, der Facebook oft vorgehalten wird: nämlich das sogenannte Bots bestimmen würden, ob ein Beitrag oder Seite berechtigt gemeldet wurde. „Oftmals nachdem ich jemandem auf Facebook geholfen habe, bekomme ich als Antwort ‚Danke, auch wenn Sie vielleicht nur ein Bot sind‘. Ich kann Ihnen allerdings versichern, dass jede einzelne Anfrage von echten Personen bearbeitet wird.“

Viele User haben verständlicherweise den Eindruck, dass es sich nur um Bots handelt, da es nicht wirklich einen persönlichen Kontakt zwischen Facebook und den Usern gibt, ein Einwand, den Lyden auch versteht. Jedoch muss man bedenken, so sagt sie, dass 1.39 Milliarden Facebook-User, welche rund um die Uhr online sind und pro Tag Millionen Beiträge melden, die Zeit für einen direkten Kontakt einfach nicht erübrigen lassen.

Um die Anzahl der Meldungen zu dezimieren, setzt Facebook nun mehr auf die Interaktion zwischen den Usern. Früher konnte man einfach nur etwas melden, die Mitarbeiter prüften die Meldungen und entschieden, ob es gegen die Gemeinschaftsstandards verstößt oder auch nicht. Nun jedoch bietet Facebook auch die Möglichkeit, sich direkt mit der Person, dessen Beitrag gemeldet werden soll, in Verbindung zu setzen, um die Sache quasi untereinander klären zu können.

„In den meisten Fällen funktioniert dieses System auch“, so Flynn. Im realen Leben gehe ich ja auch auf eine Person zu und sage ihr, was mich stört. „Wir versuchen, dieses natürliche Verhalten auch für unsere Nutzer möglich zu machen“.

Facebook hat insgesamt vier Hauptquartiere weltweit: in Kalifornien und Texas (USA), Dublin (Irland) und Hyderabad (Indien), welche sämtliche Zeitzonen abdecken. So gibt es niemals eine „Nachtschicht“, in der weniger Mitarbeiter als üblich an den Meldungen arbeiten. Darauf legt Facebook ebenfalls wert, da es auch Meldungen gibt, die besonderer Dringlichkeit bedürfen.

Wenn ein User auf „Melden“ klickt, so wird Jene je nach Grad der Schwere und Dringlichkeit dem jeweiligen Team zugesandt.Julie de Bailliencourt, die Sicherheits-Managerin für Europa, Afrika und den Nahen Osten, sagt dazu: „Besonders bei Meldungen über Mord– oder Selbstmordankündigungen, all diese Postings, die besondere Dringlichkeit verlangen, werden jene Meldungen nicht mehr durch die Teams geschleust, sondern direkt an die Polizei und Sicherheitsbehörden geleitet. Wir können nicht riskieren, dass jemand sein vermeintliches Vorhaben durch unser Zögern in die Tat umsetzt, aber durch dieses Prozedere konnten wir schon einige Menschenleben retten.“

Nun gibt es aber auch einige Kritikpunkte. Beispielsweise wurden auch schon Bilder von stillenden Müttern gelöscht, eine Sache, die de Bailliencourt als „menschlichen Fehler“ bezeichnet. Das multikulturelle Team hat oftmals hitzige Diskussionen darum, ob etwas gelöscht werden sollte oder nicht. „Manchmal geht es hier zu wie auf einer UN-Versammlung“, meint sie. Sie wissen, dass bei jeder Reaktion, ob nun ein Beitrag gelöscht wird oder nicht, es Kritik hageln wird, so muss oftmals genau abgewägt werden.

Hier einige Beispiele:

Bilder von stillenden Müttern

2011 wurde eine Gruppe gelöscht, welche Bruststillen förderte. Ein wenig später wurde die Seite jedoch wieder hergestellt, Facebook entschuldigte sich für diesen Fehler und betonte, dass sie das Recht jeder Person auf persönliche freie Meinungsäußerung unterstützen möchten.

Anstiftung zur Gewalt

2011 wurde auch eine Seite namens „Third Palestinian Intifada“ von Facebook entfernt. Jene richtete sich an Palästinenser, welche dazu aufgerufen wurden, friedlich gegen Israel zu protestieren. Gegen jene Seite gab es viele Meldungen, jedoch wurde sie erst entfernt, als die israelische Regierung sich direkt an Facebook wandte, da in der Zwischenzeit sich diese Seite zu einem Sammelsurium an Hassbotschaften und Mordaufrufen gegen Juden wandelte.

Redefreiheit

2012 entstand eine Fanseite für James Holms, der Mann, der bei der Premiere eines Batman-Films in Colorado 12 Menschen erschoss. Facebook löschte diese Gruppe nicht, da sie zwar unglaublich geschmacklos sei, jedoch nicht gegen die Regeln verstieß und innerhalb der Rede- und Meinungsfreiheit agiere.

Suizidprävention

2013 verhinderten New Yorker Polizisten den Selbstmord eines Jugendlichen, welcher von einer Brücke springen wollte und dies kurz zuvor auf Facebook ankündigte. Die Polizei selber antwortete ihm auf seine Statusmeldung und sendete Fotos von ihm an die Streifenpolizisten, bis jener Jugendliche gefunden und in ein Krankenhaus gebracht werden konnte.

„Es ist ebenfalls ein Mythos, dass es mehr bringt, wenn eine Seite oder ein Beitrag mehrmals gemeldet wird“, so de Bailliencourt. Eine Meldung wird nicht nur von einem Einzelnen behandelt, sondern immer von mehreren Mitarbeitern eines Teams. Manchmal werden Entscheidungen auch zurückgenommen, jedoch zählt nie die Masse, wie oft ein Betrag gemeldet wird.

Kontroversen wird es immer über Beiträge und Seiten auf Facebook geben. Was wir Deutschen als sehr geschmacklos empfinden, z.B. Hitler-Fanseiten, lässt Amerikaner nur schmunzeln. Das mag Vielen nicht gefallen, jedoch ist dies die Rede- und Meinungsfreiheit, die Facebook seit Anbeginn vertritt.

Jedoch legt Facebook auch Wert auf die Mündigkeit ihrer User. Auf die Interaktion zwischen Usern. Auf Gedanken- und Meinungsaustausch. Denn dadurch wurde Facebook auch das, was es heute ist: Eine Plattform, welche zwar oft Kontroversen zwischen Usern auslöst, die Welt aber auch ein wenig kleiner gemacht hat.

Autor: Ralf, mimikama.org

Quelle:

http://www.independent.co.uk/life-style/gadgets-and-tech/features/what-happens-when-you-report-abuse-the-secretive-facebook-censors-who-decide-what-is–and-what-isnt-abuse-10045437.html?origin=internalSearch

FAKE NEWS BEKÄMPFEN

Unterstützen Sie Mimikama, um gemeinsam gegen Fake News vorzugehen und die Demokratie zu stärken. Helfen Sie mit, Fake News zu stoppen!

Mit Deiner Unterstützung via PayPal, Banküberweisung, Steady oder Patreon ermöglichst Du es uns, Falschmeldungen zu entlarven und klare Fakten zu präsentieren. Jeder Beitrag, groß oder klein, macht einen Unterschied. Vielen Dank für Deine Hilfe! ❤️

Mimikama-Webshop

Unser Ziel bei Mimikama ist einfach: Wir kämpfen mit Humor und Scharfsinn gegen Desinformation und Verschwörungstheorien.

Hinweise: 1) Dieser Inhalt gibt den Stand der Dinge wieder, der zum Zeitpunkt der Veröffentlichung aktuell

war. Die Wiedergabe einzelner Bilder, Screenshots, Einbettungen oder Videosequenzen dient zur

Auseinandersetzung der Sache mit dem Thema.

2) Einzelne Beiträge (keine Faktenchecks) entstanden durch den Einsatz von maschineller Hilfe und

wurde vor der Publikation gewissenhaft von der Mimikama-Redaktion kontrolliert. (Begründung)

Mit deiner Hilfe unterstützt du eine der wichtigsten unabhängigen Informationsquellen zum Thema Fake News und Verbraucherschutz im deutschsprachigen Raum

INSERT_STEADY_CHECKOUT_HERE

Kämpfe mit uns für ein echtes, faktenbasiertes Internet! Besorgt über Falschmeldungen? Unterstütze Mimikama und hilf uns, Qualität und Vertrauen im digitalen Raum zu fördern. Dein Beitrag, egal in welcher Höhe, hilft uns, weiterhin für eine wahrheitsgetreue Online-Welt zu arbeiten. Unterstütze jetzt und mach einen echten Unterschied! Werde auch Du ein jetzt ein Botschafter von Mimikama

Mehr von Mimikama

Mimikama Workshops & Vorträge: Stark gegen Fake News!

Mit unseren Workshops erleben Sie ein Feuerwerk an Impulsen mit echtem Mehrwert in Medienkompetenz, lernen Fake News und deren Manipulation zu erkennen, schützen sich vor Falschmeldungen und deren Auswirkungen und fördern dabei einen informierten, kritischen und transparenten Umgang mit Informationen.