Deep Fakes – Können Nutzer damit erpresst werden?

Wir brauchen deine Hilfe – Unterstütze uns!

In einer Welt, die zunehmend von Fehlinformationen und Fake News überflutet wird, setzen wir bei Mimikama uns jeden Tag dafür ein, dir verlässliche und geprüfte Informationen zu bieten. Unser Engagement im Kampf gegen Desinformation bedeutet, dass wir ständig aufklären und informieren müssen, was natürlich auch Kosten verursacht.

Deine Unterstützung ist jetzt wichtiger denn je.

Wenn du den Wert unserer Arbeit erkennst und die Bedeutung einer gut informierten Gesellschaft für die Demokratie schätzt, bitten wir dich, über eine finanzielle Unterstützung nachzudenken.

Schon kleine Beiträge können einen großen Unterschied machen und helfen uns, unsere Unabhängigkeit zu bewahren und unsere Mission fortzusetzen.

So kannst du helfen!

PayPal: Für schnelle und einfache Online-Zahlungen.

Steady: für regelmäßige Unterstützung.

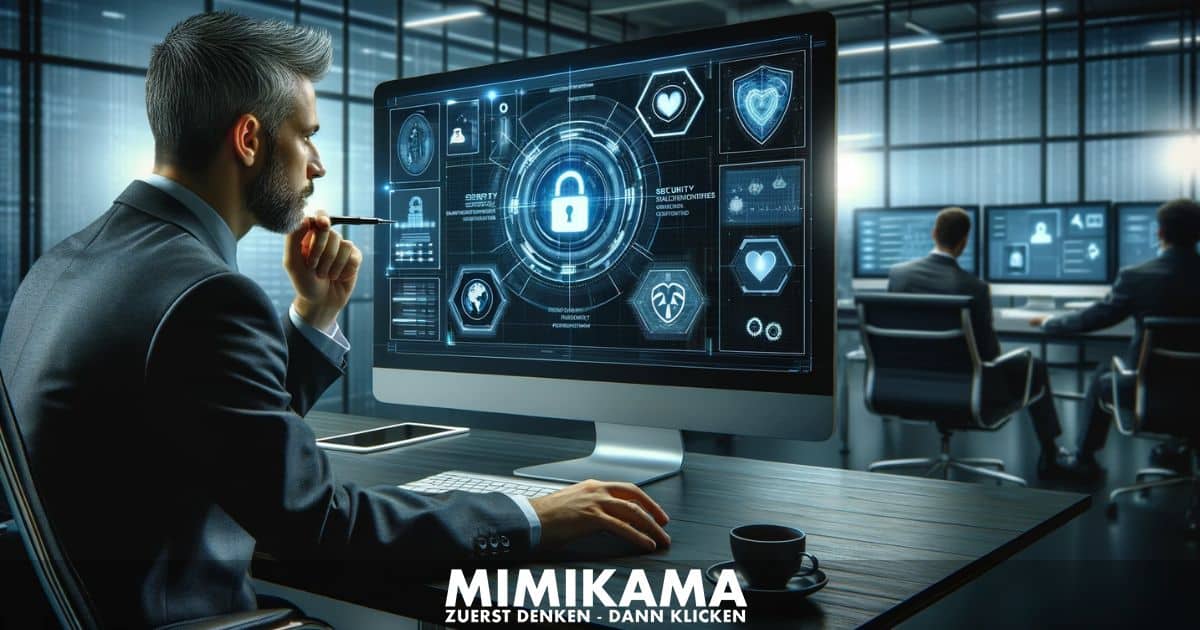

Deep Fakes – Dieser Begriff steht für gefälschte Videos, die den Eindruck machen, dass bestimmte Personen in einem Video etwas tun oder sagen, was nicht der Wahrheit entspricht.

Seit einiger Zeit bereits kursiert ein bestimmtes Tool namens „FakeApp“ im Internet. Den neugierigen Lesern sei jetzt schon gesagt, dass ihr beim Download gut aufpassen müsst, es schwirren viele virenverseuchte Versionen durchs Netz! Mit diesem Programm ist es, leistungsstarker PC und viel Zeit vorausgesetzt, möglich, Fake-Videos zu erzeugen, die in ihrer Qualität kaum von echten Videos zu unterscheiden sind. Dabei werden in den entsprechenden Videos nur die Gesichter ausgetauscht. Das „Deep“ in „Deep Fake“ steht für „deep intelligence“, also tiefere Intelligenz, da der Computer anhand von Fotos weitere Mimiken der eingefügten Gesichter errechnet.

Kann eine App denn wirklich sowas?

Nachdem diese App eher unentdeckt vom normalen Internet-Nutzer blieb, erreichte sie nun mediale Aufmerksamkeit, nachdem der Bayerische Rundfunk Anfang August über die Möglichkeiten berichtete und selbst ein gefaktes Video mit Angela Merkel erstellte. Seit es diese App gibt, erfreut sie sich bei einem bestimmten Kreis von Nutzern großer Beliebtheit, indem beispielsweise Fake-Pornos mit Prominenten erstellt werden.

Ist diese App denn legal?

Mit „FakeApp“ ist es wie mit „Photoshop“: die Programme selbst sind legal. Natürlich gerät aber ein Programm mehr und mehr in Verruf, je öfter es für mißbräuchliche Zwecke verwendet wird. Aber während Photoshop relativ teuer und die Erstellung von Fakes nicht dessen Grundfunktion ist, ist FakeApp kostenlos und speziell dafür ausgelegt, Fake-Videos zu erzeugen.

Ist das eine neue Methode?

Neu nur in dem Sinne, dass es diese App auch Privatnutzern möglich macht, jene Technologie zu verwenden. In Hollywood wird das „Face Swapping“ bereits verwendet, ein prominentes Beispiel ist die junge Prinzessin Leia Organa in „Star Wars – Rogue One“.

Kann das jeder machen?

Prinzipiell ja. Es gibt da aber einige Voraussetzungen: Der PC muss ein Windows-System haben, die Grafikkarte sollte mindestens 6 GB an Speicher besitzen und man sollte im Idealfall mehrere Hundert Fotos der Person haben, deren Gesicht man in ein Video projezieren will. Außerdem braucht es Zeit, da, je nach Leistung eines PCs, es mehrere Stunden (schwache Qualität) bis Tage dauern kann, bis ein solches Video glaubhaft fertig gerendert ist. Zudem sollte der Nutzer und die Person, dessen Gesicht im Video vertauscht werden, eine gewisse Ähnlichkeit besitzen.

Erpresser nutzen die Angst

Wenn man nur oberflächlich von „Deep Fakes“ gehört oder gelesen hat, kommt man auf die Idee, dass es sehr einfach wäre, mit jeder beliebigen Person solche Videos zu erzeugen. Erpresser nutzen dieses Unwissen nun, wie die Thüringer Polizei berichtet:

„Am 18.08.2018 erschien ein Anzeigenerstatter auf der Polizei in Meiningen um eine Erpressung anzuzeigen. Zuvor nahm er eine Freundschaftsanfrage von einer ihm unbekannten Person in Facebook an. Diese Person öffnete einen Chat und bedrohte ihn anschließend damit ein manipuliertes Video, bei welchem er eingefügt wird, in das Internet zu stellen, falls er nicht sofort Geld an ein bestimmtes Konto überweist. Der Geschädigte erstatte daher Anzeige wegen Erpressung, meldete die Person an Facebook und blockierte den Kontakt.“

Nochmal Klartext: Kann ich so erpresst werden?

Theoretisch ja. Praktisch aber ist es ein ungeheurer Aufwand, der auch noch kaum glaubhafte Ergebnisse liefert. Wie schon oben erwähnt, braucht es für so einen „Deep Fake“ hunderte von Fotos der Zielperson. Wenn man also nicht gerade jemand ist, der Hunderte Selfies auf Facebook postet, ist man schonmal auf der sicheren Seite. Außerdem ist eine bestimmter Ähnlichkeitsgrad der vertauschten Gesichter nötig.

Es ist auch möglich, mit weniger Fotos so einen „Deep Fake“ zu erstellen. Dann müssen diese Fotos allerdings auch genau in den richtigen Lichtverhältnissen aufgenommen worden sein, da die App die Lichtverhältnisse nur sehr ungenügend neu berechnen kann. Zudem müssen diese Fotos auch in verschiedenen Winkeln und Mimiken vorhanden sein, damit der Algorithmus des Programms das Gesicht „erlernen“ kann. Und das klappt so gar nicht wirklich, wenn vielleicht nur 20 Fotos vorhanden sind, die dazu noch alle verschiedene Lichtverhältnisse haben.

Deswegen klappt das auch mit Prominenten, von denen es nunmal Hunderte bis Tausende Fotos gibt, relativ gut, bei Privatpersonen hingegen ist es ein Ding der Unmöglichkeit.

Gibt es eine Möglichkeit, Deep Fake-Videos zu erkennen?

Ja. Denn so beeindruckend diese technische Möglichkeit auch ist, hat sie einen kleinen, aber bedeutsamen Fehler: Sie kann nicht das Augenzwinkern von Menschen berechnen!

In einer Untersuchung des Computer Science Department der University of Albany zeigte sich, dass die Augen in solchen Videos entweder komplett starr sind oder das Augenzwinkern sehr „verwischt“ aussieht.

Fazit

Solche Erpressungsversuche beruhen auf dem Vertrauen der Erpresser, dass ein Empfänger jener Erpressungen gar nichts oder nur sehr rudimentär von jener Technik gehört und gelesen hat. Als Laie glaubt man natürlich, dass dies sicherlich „bei der heutigen Technik“ einfach möglich ist und zahlt lieber, bevor sich ein solches Video verbreitet.

So einfach ist dies jedoch dann doch nicht. Deswegen raten wir euch, falls ihr Opfer eines solchen Erpressungsversuchs werden solltet, euch wie der Nutzer im Polizeibericht zu verhalten: nicht zahlen und der Polizei melden!

FAKE NEWS BEKÄMPFEN

Unterstützen Sie Mimikama, um gemeinsam gegen Fake News vorzugehen und die Demokratie zu stärken. Helfen Sie mit, Fake News zu stoppen!

Mit Deiner Unterstützung via PayPal, Banküberweisung, Steady oder Patreon ermöglichst Du es uns, Falschmeldungen zu entlarven und klare Fakten zu präsentieren. Jeder Beitrag, groß oder klein, macht einen Unterschied. Vielen Dank für Deine Hilfe! ❤️

Mimikama-Webshop

Unser Ziel bei Mimikama ist einfach: Wir kämpfen mit Humor und Scharfsinn gegen Desinformation und Verschwörungstheorien.

Hinweise: 1) Dieser Inhalt gibt den Stand der Dinge wieder, der zum Zeitpunkt der Veröffentlichung aktuell

war. Die Wiedergabe einzelner Bilder, Screenshots, Einbettungen oder Videosequenzen dient zur

Auseinandersetzung der Sache mit dem Thema.

2) Einzelne Beiträge (keine Faktenchecks) entstanden durch den Einsatz von maschineller Hilfe und

wurde vor der Publikation gewissenhaft von der Mimikama-Redaktion kontrolliert. (Begründung)

Mit deiner Hilfe unterstützt du eine der wichtigsten unabhängigen Informationsquellen zum Thema Fake News und Verbraucherschutz im deutschsprachigen Raum

INSERT_STEADY_CHECKOUT_HERE

Kämpfe mit uns für ein echtes, faktenbasiertes Internet! Besorgt über Falschmeldungen? Unterstütze Mimikama und hilf uns, Qualität und Vertrauen im digitalen Raum zu fördern. Dein Beitrag, egal in welcher Höhe, hilft uns, weiterhin für eine wahrheitsgetreue Online-Welt zu arbeiten. Unterstütze jetzt und mach einen echten Unterschied! Werde auch Du ein jetzt ein Botschafter von Mimikama

Mehr von Mimikama

Mimikama Workshops & Vorträge: Stark gegen Fake News!

Mit unseren Workshops erleben Sie ein Feuerwerk an Impulsen mit echtem Mehrwert in Medienkompetenz, lernen Fake News und deren Manipulation zu erkennen, schützen sich vor Falschmeldungen und deren Auswirkungen und fördern dabei einen informierten, kritischen und transparenten Umgang mit Informationen.